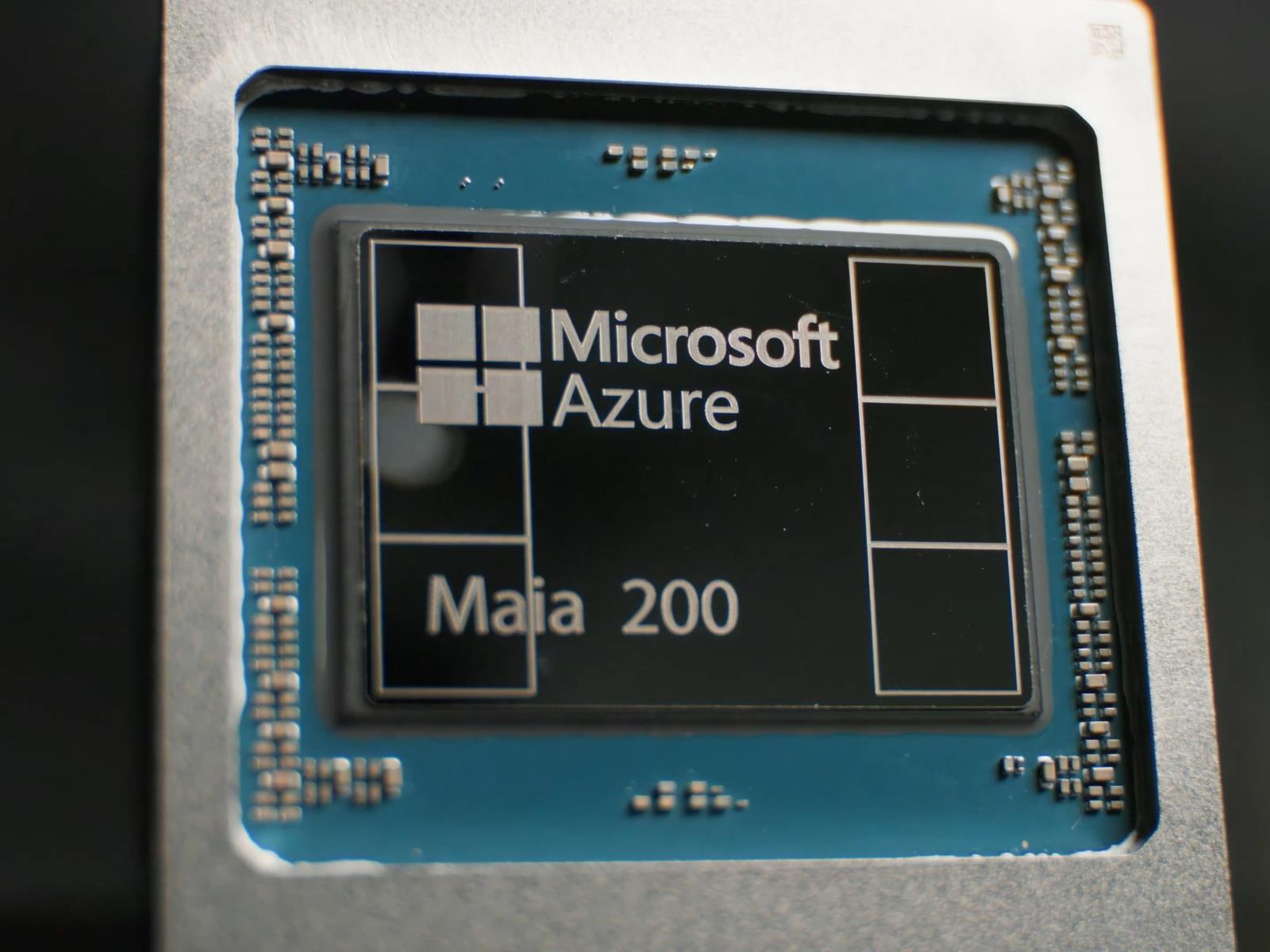

Maia 200 — Microsoft wbija klin między chmurę a dostawców

Microsoft nie czeka na łaskę rynku – zaprezentował własny akcelerator AI o nazwie Maia 200, zaprojektowany by odpalać duże modele w chmurze szybciej i taniej niż to, co działa dziś w Azure. To ruch prosty, ale skuteczny – mniej zewnętrznych zależności, więcej kontroli nad kosztem i wydajnością.

Pod maską dzieje się magia

Nie dostajemy tu bajecznych liczb od razu – dostajemy cel: przyspieszyć inferencję i obniżyć koszty operacyjne. Maia 200 to odpowiedź na rosnące zapotrzebowanie na moc obliczeniową dla dużych modeli – Microsoft chce, żeby te modele kręciły się przede wszystkim na jego sprzęcie, a nie na cudzych układach.

Chipsy w magazynie, plany w chmurze

Satya Nadella wspominał już o zapasach układów – drobna ironia: nawet mając „parę płytek w magazynie”, firma i tak inwestuje w własny projekt. Powód jest prosty – kontrola nad łańcuchem dostaw i nad tym, jak działa platforma, daje przewagę, której trudno szukać u zewnętrznych dostawców.

Co to zmienia dla użytkownika Azure

Krótko – szybsze odpowiedzi i niższe rachunki przy obciążeniach wymagających dużych modeli. Dla firm oznacza to mniejsze koszty skalowania i większą pewność, że optymalizacje sprzętowe będą dostępne bez czekania na harmonogramy zewnętrznych partnerów.

- Mniej zależności od dostawców – mniejsze ryzyko przerw.

- Lepsza optymalizacja pod konkretne modele – niższe koszty obliczeń.

- Większa elastyczność wdrożeń w chmurze – szybsze testy i iteracje.

Microsoft idzie na swoje – i nie robi tego na pokaz

To nie tylko chęć posiadania kolejnego kawałka krzemu – to strategiczny ruch. Jeśli twoja aplikacja chce skalować modele w chmurze, licz się z tym, że nadchodzi era większej kontroli ze strony dostawców chmury. A kto lubi niespodzianki na rachunku – ten powinien to obserwować uważnie.